Nikt nie rozumie świata, w którym żyje, ale niektórzy są w tym lepsi od innych.

Richard Feynman

Falowe szaleństwa

Wielokrotnie w historii świata, człowiek zapędzał się zbyt daleko w swej zarozumiałości. Naiwnie sądził, że objął już swym niedoskonałym umysłem strukturę wszechświata, aby zaraz później uświadomić sobie, w jakim żył błędzie. Dokładnie tak prezentował się krajobraz fizyki na przełomie XIX i XX stulecia. Ludzkość korzystała ze wspaniałych praw Izaaka Newtona, a resztę zdawał się tłumaczyć elektromagnetyzm. Słychać było głosy, jakoby najważniejsze reguły gry zostały już poznane, a reszta to tylko kwestia technologii i wyzwanie dla inżynierów.

Odkrycia nowo powstałej fizyki jądrowej pozwoliły na nakreślenie pierwszych, planetarnych modeli atomu. Nie były one zbyt skomplikowane, czerpały z dotychczasowych wzorców i przewidywały, że wszelka materia zbudowana jest jedynie z trzech rodzajów cząstek (protonów, elektronów i odkrytych nieco później neutronów) zachowujących się analogicznie do ciał Układu Słonecznego. Wydawało się, że nauka rzeczywiście stoi o krok od poznania podstawowych zasad funkcjonowania rzeczywistości, jak również budowy materii na jej najbardziej elementarnym poziomie i niewiele może się w tej kwestii wydarzyć.

Jednak wydarzyło się wiele.

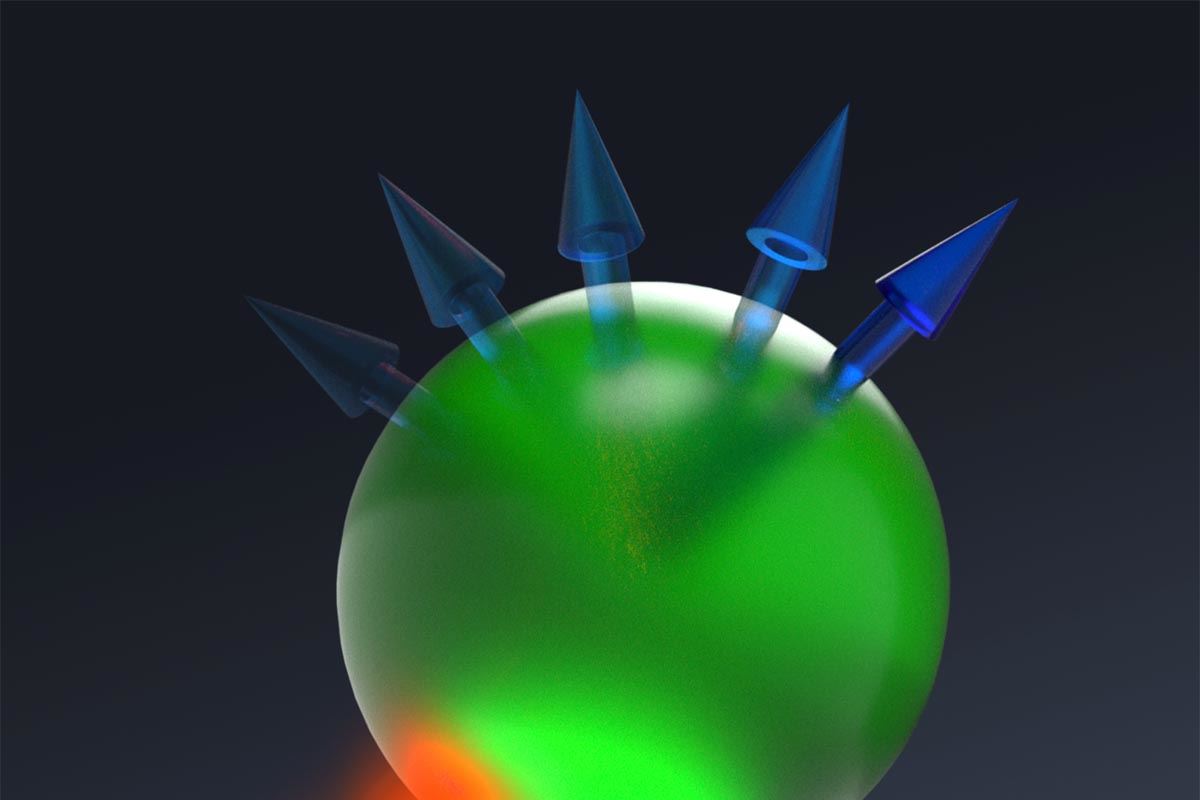

będącego w istocie wnęką,

utrudniającą odbicie światła

dochodzącego z zewnątrz.

Kolejną wielką rewolucję naukową zainicjował problem równie banalny i przyziemny co jabłko Newtona. Rzecz dotyczyła tego, w jaki sposób dochodzi do wypromieniowywania energii przez rozgrzaną materię. Pewnie zdajesz sobie sprawę, że nawet Twoje ciało w tym momencie świeci – tyle że w niewidocznej dla ludzkiego oka podczerwieni. Ale już rozżarzony kawałek metalu potrafi przybrać barwę wyraźnej czerwieni lub nawet bieli. W omawianym okresie cały szereg znamienitych uczonych stawał na głowie, próbując sformułować fizyczny opis tego zjawiska. Wielką pomocą naukową okazał się odkryty nieco wcześniej koncept ciała doskonale czarnego. Wbrew nazwie chodzi o obiekt, który może świecić, ale wyłącznie światłem własnym, w ogóle nie odbijając promieni dochodzących do niego z zewnątrz. W praktyce więc schłodzone ciało doskonale czarne rzeczywiście pozostaje czarne, ale po podgrzaniu zaczyna emitować światło. Pozwoliło to na przeprowadzenie bardzo skrupulatnej analizy widma wypromieniowywanego światła. Przy dużych temperaturach tylko niewielka część promieniowania przypadała na duże długości fali, zaś większość na fale średnie i krótkie. Większa energia oznaczała zatem krótszą falę światła i wyższą częstotliwość, czyli przesunięcie widma w stronę ultrafioletu. To nie było dziwne. Niepokojący okazał się inny fakt. Obserwacji nie odzwierciedlał prawidłowo żaden z dostępnych wzorów. Dawały one wyniki nieskończone, tak jakby rozżarzone ciało potrafiło emitować nieskończoną ilość energii przy najwyższych częstotliwościach, co oczywiście nie jest prawdą. Sytuacja wydała się teoretykom na tyle dramatyczna, że określili ją mianem katastrofy w ultrafiolecie.

W przeciągu kilkunastu lat pojawiło się przynajmniej dziesięć propozycji równań opisujących emisję ciała doskonale czarnego. Cel osiągnął pod koniec 1900 roku profesor Uniwersytetu Berlińskiego, Max Planck. Wprowadził on do obliczeń dodatkowy element zwany dzisiaj stałą Plancka, nakazując porcjować emitowane promieniowanie. Może Cię to zaskoczy, ale za zamysłem fizyka nie stały żadne głębsze rozważania, żadna nowatorska filozofia. Był to ruch czysto matematyczny, sposób na dostosowanie równania do wyników obserwacji. Jeszcze długo po wydaniu publikacji Planck nie chciał stawiać twardych sądów i dopiero po latach przyjął do wiadomości, że energia we wszechświecie rzeczywiście podlega szatkowaniu na dyskretne minimalne kawałki. Promieniowanie można i trzeba kwantować. Planck przeczuwał, że nowe podejście do rzeczywistości wiele namiesza, ale nie mógł przewidzieć, że otwiera naukową puszkę Pandory.

Fala jest trochę cząstką, cząstka jest trochę falą

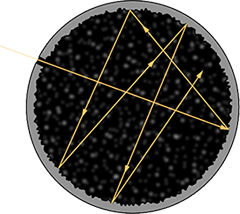

Koncept kwantu bardzo dosłownie potraktował Albert Einstein. Młodszy kolega Plancka, pięć lat później przekonał świat, że światło w istocie składa się z małych kawałeczków, zwanych obecnie fotonami. Miało to niebagatelne konsekwencje, ponieważ wymagało zmiany, a właściwie powrotu do dawnego schematu myślenia. Sam pomysł istnienia cząstek światła pojawiał się na kartach historii nauki kilkukrotnie, lecz przez stulecie przegrywał z interpretacją traktującą światło jako falę. Genialny Thomas Young już na początku XIX wieku wykonał słynne doświadczenie z dwiema szczelinami, bezpośrednio utwierdzające taki pogląd. Po przepuszczeniu promienia światła przez odpowiednie przeszkody, na ekranie pojawiał się charakterystyczny wzór interferencyjny, wynikający ze wzajemnego wzmacniania i wygaszania fali. Tymczasem prace Plancka i Einsteina przekonywały, że światło mimo tego dowodu, powinno być zbudowane z możliwych do wyodrębnienia pocisków. Świadczyło o tym zjawisko fotoelektryczne, polegające na wybijaniu elektronów z metalu podczas wystawiania go na działanie promieniowania elektromagnetycznego. Pasująca teoria zakładała, iż elektrony były poruszane przez dyskretne fotony.

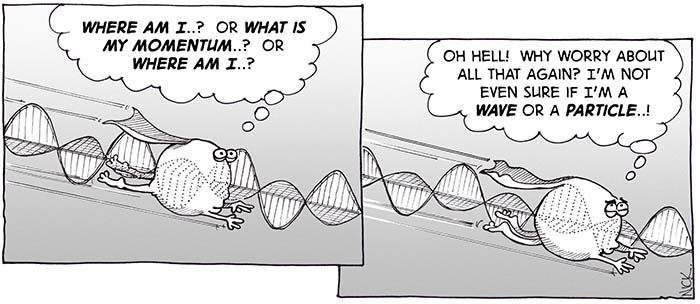

Dwa doświadczenia przynosiły zupełnie odrębne wnioski i dostarczały argumentów obu stronom sporu. Żeby było jeszcze ciekawiej, niebawem okazało się, że światło nie stanowi żadnego ewenementu. Francuski fizyk Louis de Broglie, wykazał, że dokładnie taki sam paradoks tyczy się obecnych we wszystkich atomach elektronów. Wyartykułujmy to wprost. Fotony, jak również pospolite cząstki budujące materię, zachowują się w zależności od sytuacji raz jak namacalna drobina, a raz jako fala. Posiadają zdolność, zupełnie nieznaną dużym obiektom. Wszystkie byty mikroświata wykazują dualizm korpuskularno-falowy. Nikt nie popełnił błędu. Rodząca się mechanika kwantowa wymagała po prostu uznawania czegoś za coś innego i odwrotnie, nawet jeśli stało to w opozycji do schematów fizyki klasycznej.

Umarł król, niech żyje król

O ile Plancka i ewentualnie Einsteina można uznać za dziadków mechaniki kwantowej, o tyle do ojców świeżej teorii należy zaliczyć Nielsa Bohra, Louis de Broglie’a, Wolfganga Pauliego, Wernera Heisenberga oraz Erwina Schrödingera. Jak sugeruje ta wyliczanka, fizyka kwantów nie powstała na skutek pojedynczego skoku, lecz dzięki wielu drobnym, acz ważnym krokom dokonanym na przestrzeni kilku dekad. Rzecz jasna nie będziemy w tym cyklu wchodzić w szczegóły, ale jeśli jesteś ciekawy, to gorąco zachęcam Cię do zapoznania się z zasadą nieoznaczoności, pojęciem superpozycji, zagadnieniem sumowania po trajektoriach, efektem splątania kwantowego, czy wreszcie interpretacjami zjawisk kwantowych.

Wszystko sprowadza się do faktu, iż standardowy sposób myślenia o fizyce musiał ustąpić miejsca nowemu. Przynajmniej w skali subatomowej. Nagle okazało się, że cząstka elementarna wcale nie musi zachowywać się jak zwarty obiekt. Atom w żaden sposób nie przypomina Układu Słonecznego, a elektrony z całą pewnością nie krążą wokół jądra podobnie do planet. Nie da się określić ze stuprocentową dokładnością gdzie leży cząstka jeżeli znamy jej pęd, a gdy odkrywamy lokalizację, to tracimy dane o pędzie. Kwantowy byt wystrzelony w stronę przeszkody pokonuje wszystkie możliwe drogi prowadzące do celu, a jedynie prawdopodobieństwo decyduje o tym, na której trasie szansa spotkania go będzie największa.

To jest niemal jak sen – a dla fizyków prawdziwy koszmar. Spójrzmy od drugiej strony. Jeśli obserwujemy jakiekolwiek poruszające się ciało, potrafimy podać jego lokalizację, jak również obliczyć prędkość, pęd i przewidzieć jego położenie w przyszłości. Dla fizyka dokładne wyliczenie pozycji planety, komety czy asteroidy nie stanowi większego wyzwania. Na poziomie wielkości subatomowych nie istnieje taka możliwość. Ani w praktyce, ani w teorii.

Teraz puenta. Albert Einstein uważał, że jeżeli tylko połączy grawitację (zawartą w ogólnej teorii względności) z elektromagnetyzmem to odnajdzie uniwersalną zasadę rządzącą wszechświatem. Mechanika kwantowa pokazała, że jedyne, na co może liczyć Einstein, to odkrycie zasad rządzących rzeczywistością dużych obiektów – począwszy od jabłek, kończąc na galaktykach. Nijak ma się to jednak do atomów i cząstek elementarnych. Geniusz nie mógł się z tym pogodzić, idąc w zaparte, że “Bóg nie gra w kości”! Nie, nie podważał samych równań Heisenberga czy Schrödingera, bo zdawał sobie sprawę z ich poprawności. Mechanika kwantowa była jednak dlań dziurawa, podobnie jak niegdyś model grawitacji Newtona. Ironią losu wydaje się fakt, że przecież to sam Einstein pomógł Planckowi dać podwaliny pod tę nieznośną teorię. Teraz naukowiec zmuszony został do odwrotu, jako jeden z nielicznych autorytetów stojących w opozycji do mechaniki kwantowej. Jak podsumował to wiele lat później Stephen Hawking: “Pogubił się Einstein, nie mechanika kwantowa”.

Dwie siły to za mało

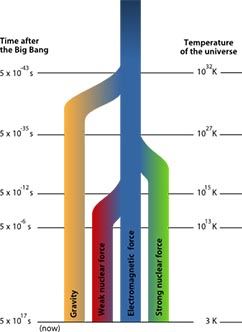

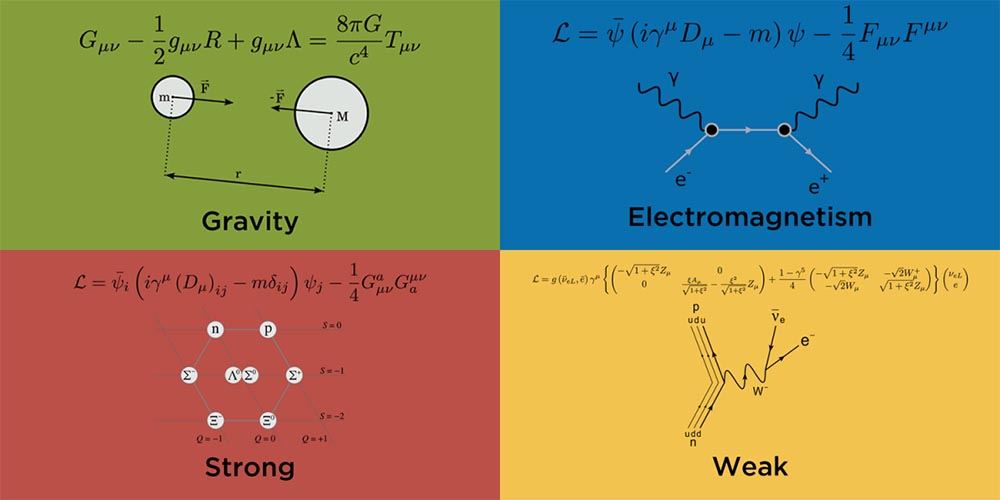

Jak ustaliliśmy, planetarny model atomu nie jest poprawny, a dotychczasowe teorie nie wystarczają do opisu struktury rzeczywistości. Następne pokolenie fizyków zrozumiało, że zachowanie cząstek i atomów wskazuje na obecność nieznanych dotąd sił, różnych od grawitacji czy elektromagnetyzmu i widocznych wyłącznie na bardzo małych dystansach. W ten sposób na firmamencie fizyki pojawiły się dwa nowe oddziaływania podstawowe o niezbyt wyszukanych nazwach. Pierwsze to oddziaływanie silne, odpowiadające za utrzymywanie w ryzach protonów i neutronów, co zapewnia wyjątkową stabilność jądrom atomowym. Drugie to oddziaływanie słabe, pośredniczące w procesie rozpadu pierwiastków i tłumaczące związaną z nim radioaktywność. Rola elektromagnetyzmu sprowadza się do przyciągania ujemnie naładowanych elektronów do dodatnich protonów. Oczywiście mechanizm każdej z tych sił (poza grawitacją) doczekał się opasłej analizy na gruncie teorii kwantów.

Cztery oddziaływania (grawitacja, elektromagnetyzm, oddziaływanie silne i słabe) oznaczały znaczne oddalenie planów unifikacji. Tym razem, aby mieć nadzieję na stworzenie teorii ostatecznej należało połączyć już nie dwie, a cztery siły rządzące wszystkim co nas otacza. Aż chce się sięgnąć do humorystycznej reguły: teoria jest wtedy, kiedy wszystko wiemy ale nic nie działa, natomiast praktyka wtedy, kiedy wszystko działa, ale nikt nie wie dlaczego. W przypadku mechaniki kwantowej naukowcy zaprezentowali zdecydowanie praktyczne podejście. Mimo, że ludzkość ujarzmiła potencjał atomu, to jednak pozwoliła na wypuszczenie z rąk szansy na zjednoczenie praw fizyki.

Sytuacja stała się jeszcze ciekawsza po uruchomieniu gigantycznych obiektów badawczych, służących do zderzania i rozkwaszania cząstek subatomowych. Akceleratory szybko ujawniły, że to co nazywaliśmy cząstkami elementarnymi, częstokroć daje się rozbić na jeszcze mniejsze elementy. W ten sposób oczom uczonych ukazała się cała menażeria mikroskopijnych drobin, na oznaczenie których niemal zabrakło liter w alfabecie. Nie wiadomo już było ani czy da się zunifikować oddziaływania fizyczne, ani co naprawdę stanowi elementarny budulec materii.

Cztery siły to za wiele

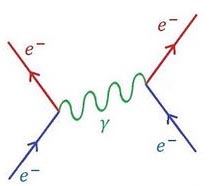

Kiedy fundamenty mechaniki kwantowej zostały już ustanowione, dalsze postępy wymagały uzgodnienia z nią dotychczasowej wiedzy o oddziaływaniach i cząstkach. Właśnie na tym polu swój największy naukowy triumf osiągnął znany z ciętego humoru i zamiłowania do bongosów Richard Feynman. Popularny fizyk rzucił w kąt skomplikowane równania, pomagając sobie graficznymi bazgrołami pełnymi kresek i strzałek. Dzięki tak zwanym diagramom Feynmana, ich autor rozrysował nową teorię: elektrodynamikę kwantową lub po prostu QED (Quantum Electrodynamics). Jak ujął to sam uczony w swojej książce, QED stanowiła “osobliwą teorię światła i materii lub, ściśle mówiąc, oddziaływania światła i elektronów”. Do tego czasu złożone obliczenia mające zobrazować tego typu – w gruncie rzeczy proste zjawiska – przynosiły badaczom bzdurne, najeżone nieskończonościami wyniki. Feynman dzięki swoim diagramom i różnym sztuczkom matematycznym doprowadził do renormalizacji i rezultatów nadzwyczaj zbieżnych z wynikami doświadczeń. Być może nie wydaje Ci się aby anonimowe dla większości ludzi QED było szczególnie istotne, ale w istocie nowa teoria do chwili obecnej skutecznie tłumaczy ogrom pospolitych efektów. Począwszy od tego, że możemy optycznie badać świat, a kończąc na reakcjach chemicznych i wydarzeniach zachodzących wewnątrz atomów. Stąd Nobel w dziedzinie fizyki za rok 1965 przypadł Richardowi Feynmanowi.

Po zgrabnym wyjaśnieniu jak wyglądają interakcje fotonów z elektronami, fizycy skupili na tym co mechanika kwantowa może powiedzieć o strukturze samego jądra atomu oraz o jego rozpadzie. Pierwszy problem rozwiązała chromodynamika kwantowa (QCD, Quantum Chromodynamics) opisująca oddziaływanie silne, wprowadzając do gry kwarki, gluony, mezony pi i ładunki kolorowe. Do rozwikłania drugiej zagadki, związanej z oddziaływaniem słabym, konieczny był zestaw cząstek W(+), W(-) i Z(0). Tak, wiem, że dużo tego wszystkiego i nie zabiegam o to, abyś na potrzeby niniejszego cyklu przestudiował nagle całą fizykę cząstek elementarnych. Skupmy się lepiej na tym, co pomoże nam wrócić na tory prowadzące do teorii wszystkiego.

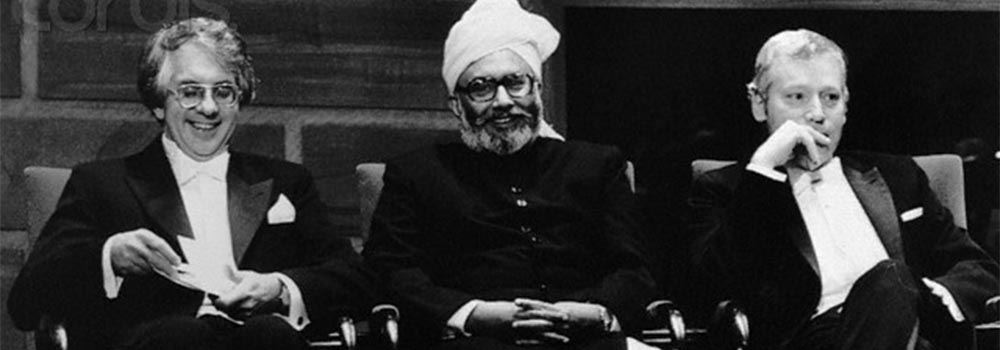

Słowem-kluczem, które jeszcze powróci w następnych tekstach, będzie tu symetria. Uciekając się do symetrii cechowania, tercet znamienitych fizyków – Sheldon Glashow, Abdus Salam oraz Steven Weinberg (na zdjęciu powyżej) – stanął przed ambitnym zadaniem uprzątnięcia tego galimatiasu.

Teoretycy zapragnęli wykazać, że dobrze znany elektromagnetyzm oraz przysparzające kłopotów oddziaływanie słabe, to w istocie przejaw jednego i tego samego. Zgodnie z tą odważną myślą, foton przenoszący elektromagnetyzm oraz cząstki W i Z pośredniczące w rozpadzie, pozostają ze sobą spokrewnieni, choć z jakiegoś powodu niechętnie się tym chwalą. Dlaczego w pospolitych warunkach bliźniacze cegiełki wyglądają zupełnie inaczej? Bo brakuje symetrii, której złamanie nadało różnym cząstkom różną masę. To trochę tak jakbyśmy mieli do dyspozycji bliźniaków i jednego tak utuczyli, że z pozoru przestaje przypominać rodzonego brata.

Jak przywrócić symetrię i zweryfikować teorię? Jak odchudzić cząstkę? Jesteś gotów sam wpaść na ten pomysł, jeśli tylko przypomnisz sobie postulaty szczególnej teorii względności. Skoro foton nie posiada w ogóle masy spoczynkowej i mknie przez przestrzeń z prędkością światła, to jego “zegar” pozostaje zamrożony względem obserwatorów. Jeżeli nadamy cząstkom W i Z prędkość przynajmniej bliską światłu, możemy zaobserwować jak zaczynają przypominać foton. Jeśli nadal nie rozumiesz, odwołam się do nieco bardziej plastycznej metafory Hawkinga. “Ten efekt przypomina zachowanie kulki ruletki. Gdy energia jest wysoka, kulka zachowuje się zawsze w ten sam sposób – po prostu toczy się po kole. Ale gdy koło zwalnia, kulka traci energię i w końcu wpada do jednej z 37 przegródek. Inaczej mówiąc, możliwych jest 37 różnych stanów kulki w niskich energiach”. W ten właśnie sposób, porządne kopnięcie cząstek w akceleratorze potrafi ukazać ich skrywaną naturę.

Salam, Glashow i Weinberg zunifikowali elektromagnetyzm i oddziaływanie słabe, tworząc teorię oddziaływania elektrosłabego. Był to pierwszy od czasu Jamesa Clerka Maxwella, tak poważny krok ku ujednoliceniu fizyki. Chcąc iść za ciosem, niemal natychmiast uczeni zwrócili się ku oddziaływaniu silnemu, kierując się analogicznym rozumowaniem. Podjęte wyzwanie nosi nazwę teorii wielkiej unifikacji (GUT, Grand Unified Theory), dla odróżnienia od teorii elektrosłabej, będącej teorią małej unifikacji. Kluczowe pozostaje założenie, iż istnieje jeszcze głębsza symetria, zaś gluon to członek jednej rodziny cząstek, wraz z fotonem, wuonem i zetonem, których podobieństwo ujawni się przy ekstremalnie dużych energiach. Tak wielkich, że sprawdzenie słuszności GUT znajduje się poza zasięgiem technicznych możliwości człowieka, przynajmniej na razie. Jeśli współczesna fizyka się nie myli, to w ogniu wielkiego wybuchu musiało królować jedno super-oddziaływanie, z którego, w miarę stygnięcia wszechświata i spontanicznego łamania symetrii, najpierw wyodrębniła się grawitacja, później oddziaływanie silne, a na końcu oddziaływanie słabe i elektromagnetyczne.

Zasłona milczenia

Zunifikowanie oddziaływania słabego z elektromagnetyzmem oraz postulaty GUT, doczekały się połączenia w ramach tzw. modelu standardowego. Model ten stanowi bezsprzeczny triumf fizyki teoretycznej, lecz jednocześnie, od samego początku zmaga się z poważną bolączką. Genialni fizycy pracujący nad teorią wielkiej unifikacji, doszli do wiekopomnych odkryć i zasłużonych zaszczytów, całkowicie pomijając bliską nam wszystkim grawitację. Ich rozważania w ogóle się do niej nie odnoszą. Wypracowany w pocie czoła model standardowy jej nie uwzględnia. Dopiero w ciągu ostatnich kilku dekad podjęto ten problemem na poważnie. Lekarstwem na chorobę być może okaże się jedna z najbardziej niezwykłych teorii w historii współczesnej nauki – teoria strun.

Ciąg dalszy nastąpi.

Literatura uzupełniająca:

L. Lederman, D. Teresi, Boska cząstka. Jeśli Wszechświat jest odpowiedzią, jak brzmi pytanie?, przeł. E. Kołodziej-Józefowicz, Warszawa 2005;

J. Gribbin, W poszukiwaniu kota Schrödingera. Realizm w fizyce kwantowej, przeł. J. Bieroń, Warszawa 1997;

R. Feynman, QED. Osobliwa teoria światła i materii, przeł. H. Białkowska, Warszawa 2002;

S. Hawking, Krótka historia czasu, Warszawa 2007;

B. Greene, Piękno wszechświata. Superstruny, ukryte wymiary i poszukiwanie teorii ostatecznej, przeł. E. Łokas, Warszawa 2002;

W. Issacson, Einstein. Jego życie, jego wszechświat, przeł. J. Skowroński, Warszawa 2010;

A. K. Wróblewski, Historia fizyki. Od czasów najdawniejszych do współczesności, Warszawa 2015;

Wpis stanowi odświeżoną wersję tekstu z sierpnia 2012 roku.